- Diagnóstico rápido para saber si Google te ve

- Causas técnicas que bloquean el rastreo

- De rastreo a indexación lo que necesita Google

- Cuando sí estás indexado pero no posicionas

- Casos especiales que tiran tu visibilidad

- Plan de acción priorizado para aparecer en Google

- Árbol de decisión para diagnosticar por escenarios

- Implementación rápida por CMS

- Preguntas frecuentes que te ahorran tiempo

Es frustrante invertir tiempo y esfuerzo en un sitio web y que este no aparezca en los resultados de búsqueda de Google. Si te preguntas “¿por qué mi web no aparece en Google?”, aquí tienes una guía profesional, directa al grano y pensada para que pases del diagnóstico a la solución en el menor tiempo posible. Voy a ayudarte a entender qué está fallando (rastreo, indexación o ranking) y qué hacer exactamente en cada caso.

Antes de entrar en materia, una aclaración clave: “aparecer” no es lo mismo que “posicionar”. Puedes estar indexado y aun así no salir en las primeras páginas. En mi experiencia, la mayoría de problemas nacen en tres capas:

- Google no descubre tus URLs (rastreo),

- Las descubre, pero decide no guardarlas (indexación),

- Las guarda, pero no merecen estar arriba para la intención de búsqueda.

Este análisis SEO te ayudará a entender las posibles causas y a encontrar soluciones reales.

Diagnóstico rápido para saber si Google te ve

Comando site y señales de indexación

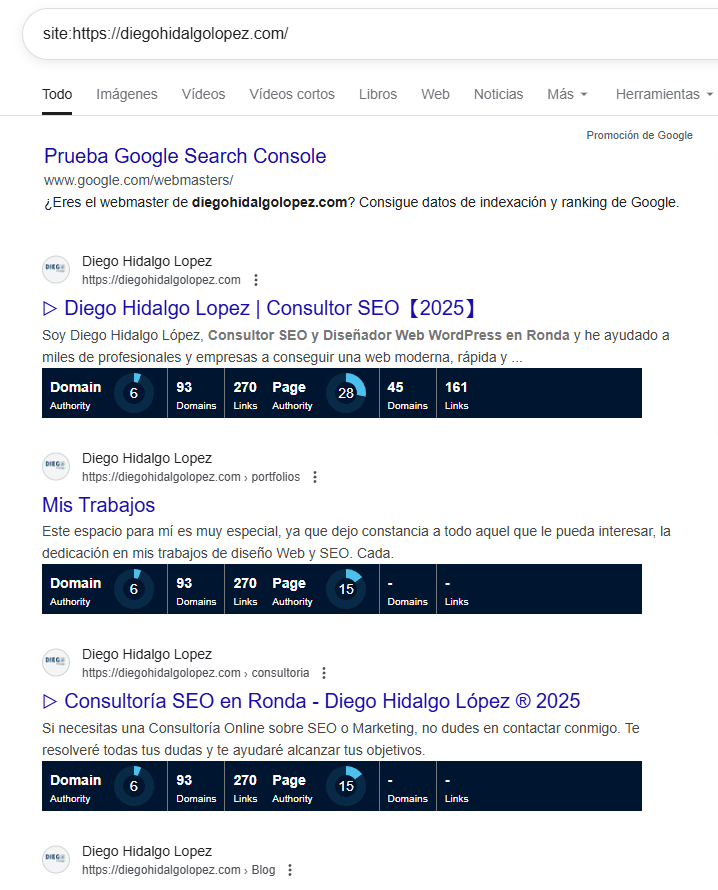

El primer paso es confirmar si Google tiene algo de tu sitio en su índice. Escribe site:tudominio.com en Google. Si no aparece nada, estás ante un problema de descubrimiento o de indexación. Si aparecen muy pocas páginas o títulos raros (por ejemplo “Inicio” repetido), hay señales de que Google te rastrea poco o de que tu etiqueta de título/estructura de enlaces no está optimizada.

Además, revisa la caché: cache:tudominio.com. Si existe, verás cuándo Google capturó por última vez tu home; si falta, puede ser normal en sitios nuevos, pero si llevas semanas online, conviene profundizar. Por último, busca tu marca tal cual (con y sin acentos). Si ni tu nombre aparece, la huella de marca es débil y necesitarás señales externas (enlaces, menciones, ficha de Google Business Profile) para acelerar el descubrimiento.

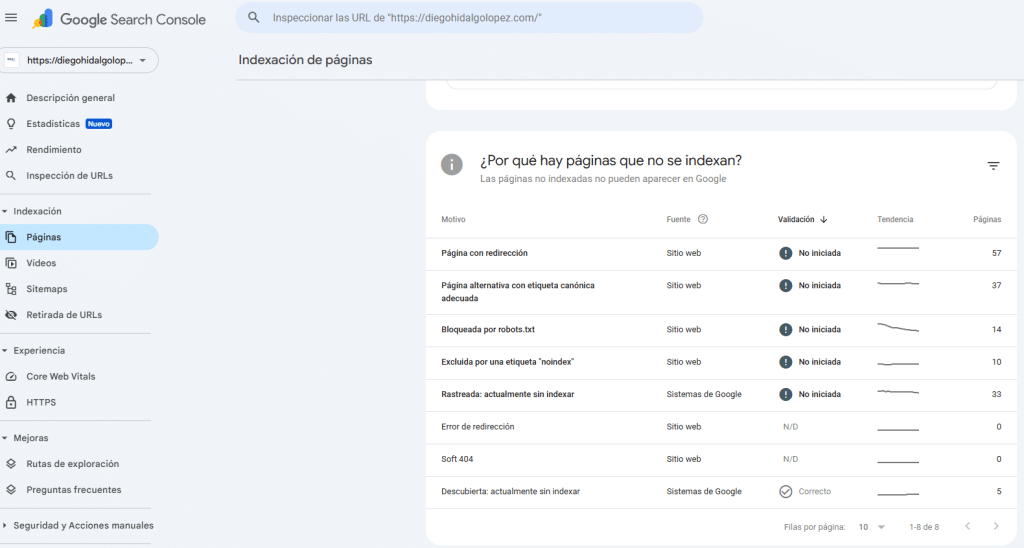

Inspección de URL en Search Console

Abre Google Search Console (GSC), pega una URL concreta en “Inspección de URL” y mira el estado. Si ves “La URL no está en Google”, revisa el motivo: “No se ha rastreado”, “Excluida con ‘noindex’”, “Bloqueada por robots.txt”, “Descubierta pero no indexada”, “Alternativa con etiqueta canónica adecuada”, etc. Cada estado te dice exactamente dónde atacar.

Cuando la URL sea válida pero no indexada, solicita indexación desde GSC (acelera el proceso, no lo garantiza). Y si el sitio es nuevo, recuerda que Google puede tardar desde unas horas hasta varias semanas en descubrirlo por sí mismo. No esperes resultados inmediatos; el SEO es un proceso continuo que requiere tiempo y ajustes.

Qué significa estar indexado pero no aparecer

Si site: devuelve tus páginas pero no las ves para tus consultas, el problema no es de indexación sino de posicionamiento: intención de búsqueda mal cubierta, contenido débil o señales insuficientes de calidad/autoridad. En ese caso, céntrate en mejorar la pertinencia (qué responde tu contenido), la calidad (profundidad, originalidad, ejemplos) y las señales (enlazado interno, backlinks relevantes, comportamiento del usuario y Core Web Vitals).

Causas técnicas que bloquean el rastreo

Revisar robots txt sin romper nada

El archivo robots.txt controla qué puede rastrear Google. Un Disallow: / en producción o directorios críticos bloqueados impiden el rastreo. Ojo con patrones demasiado agresivos (por ejemplo, bloquear /wp- puede impedir servir recursos necesarios). Buenas prácticas: permitir CSS/JS esenciales, declarar tu sitemap, y evitar “recetas universales” copiadas sin entender.

Ejemplo mínimo seguro:

User-agent: *

Allow: /

Sitemap: https://tudominio.com/sitemap.xmlSi necesitas excluir áreas privadas, sé específico (Disallow: /admin/). Evita usar robots.txt para “desindexar” (no sirve para eso). Si una URL ya está en Google y no la quieres, usa noindex o devuelve 410/404 con redirección oportuna.

Etiquetas noindex en HTML y en cabeceras

Otra causa típica es tener noindex sin querer. Comprueba en el HTML:

<meta name="robots" content="noindex,nofollow">Y también a nivel servidor mediante X-Robots-Tag (muchas veces olvidado):

X-Robots-Tag: noindexSi tienes noindex en cualquiera de los dos, Google rastreará la URL pero la excluirá del índice. Quita el noindex, vuelve a solicitar indexación y verifica en GSC en los días siguientes. Recuerda: robots.txt bloquea el rastreo; noindex impide la indexación; son cosas diferentes.

Servidor, errores 5xx y tiempos de respuesta

Google asigna un tiempo de rastreo. Si tu servidor responde lento o devuelve 5xx, el bot reduce el ritmo y descubre menos páginas. Monitoriza “Estadísticas de rastreo” en GSC: si el tiempo de respuesta sube, verás caer las solicitudes. Optimiza cachés, CDN y TTFB, elimina cadenas de redirecciones y corrige 5xx. Un sitio estable y rápido se rastrea más y mejor.

De rastreo a indexación lo que necesita Google

Enviar y depurar el sitemap

El sitemap no “obliga” a indexar, pero ayuda a descubrir y priorizar. Súbelo a https://tudominio.com/sitemap.xml y decláralo en GSC. Incluye solo URLs canónicas 200, útiles y enlazadas internamente. Si cambias una URL, actualiza el sitemap y elimina las antiguas; evita listar 301/404. Comprueba que el recuento “enviadas vs indexadas” progresa: si no, hay problemas de calidad o duplicidad.

Enlazado interno que descubre páginas nuevas

Google navega por enlaces. Si publicas una página y no la enlazas desde ninguna parte, dependerás del sitemap o de enlaces externos. Crea vínculos desde categorías, hubs temáticos y artículos relacionados. Usa anchor text descriptivos, evita bucles de redirecciones y revisa que no existan enlaces hacia URLs no canónicas. Un buen interlinking reparte autoridad y acelera el descubrimiento.

Canibalización y canónicas bien aplicadas

Si varias URLs compiten por la misma intención, Google puede dudar cuál mostrar, o alternar resultados. Define una URL líder y apóyate en rel="canonical" cuando existan duplicados parciales. No uses canónica para “redirigir” intenciones distintas: reorganiza el contenido y fusiona si hace falta. Valida siempre en GSC qué versión elige Google como canónica.

Cuando sí estás indexado pero no posicionas

Intención de búsqueda y calidad del contenido

Antes de escribir, analiza qué premian los primeros resultados: ¿guías técnicas, checklists, tutoriales con capturas, o respuestas cortas? Ajusta tu contenido a esa intención y supera su profundidad con ejemplos propios, FAQs reales y pasos accionables. Mantén la keyword principal en los primeros párrafos y usa variantes naturales, sin forzar.

Integra E‑E‑A‑T: experiencia, especialización, autoridad y fiabilidad. Aporta quién firma, por qué debe confiar el lector, fuentes, capturas y advertencias donde proceda. “En mi caso”, suelo combinar diagnóstico en GSC con un rastreo de Screaming Frog para localizar noindex, bloqueos en robots.txt, thin content y canónicas incoherentes. Ese mix detecta el 80% de los problemas en sitios pequeños.

Thin content y duplicados cómo detectarlos

Si una URL apenas aporta valor o repite lo ya dicho en otra parte, será difícil que compita. Une piezas superficiales en un contenido fuerte, elimina páginas sin propósito y centraliza temas en hubs. Usa herramientas para ver duplicados parciales, cadenas de paginación mal resueltas o listados sin contenido original. Cuando fusiones, redirige con 301 a la versión final.

UX y Core Web Vitals que mueven la aguja

La experiencia del usuario importa: velocidad, estabilidad visual, interactividad y legibilidad. Optimiza imágenes, JS y fuentes; cuida el diseño móvil y los clics importantes por encima del pliegue. Una buena UX mejora señales de comportamiento y reduce el pogo‑sticking, favoreciendo el rendimiento orgánico. Si tienes negocio local, refuerza con Google Business Profile y reseñas genuinas.

Casos especiales que tiran tu visibilidad

Acciones manuales y problemas de seguridad

En GSC, revisa “Acciones manuales” y “Problemas de seguridad”. Si fuiste hackeado o te detectan spam, Google puede desindexar o degradar muchas URLs. Prioriza limpieza, parches y re‑revisión. Documenta el proceso y solicita reconsideración cuando acabes.

Actualizaciones de algoritmo y qué priorizar esta semana

Tras una gran actualización, tu sitio puede perder visibilidad sin que haya errores técnicos. Evalúa la brecha con respecto a los líderes: cobertura temática, utilidad, autoridad y señales de marca. Mejora calidad y foco por clústeres, refuerza interlinking y elimina contenido que no aporta. Evita “arreglos mágicos”; aquí manda el valor real para el usuario.

JavaScript y renderizado que oculta tu contenido

Si tu contenido depende de JS, asegúrate de que Google lo ve. La opción más robusta es renderizar en servidor o usar pre‑rendering para contenido crítico. Comprueba con “Ver página procesada” y compara HTML inicial vs DOM final. Si Google solo ve un lienzo vacío, no indexará lo importante.

Plan de acción priorizado para aparecer en Google

Checklist en 24 horas para sitios nuevos

- Verifica la propiedad en GSC y envía el sitemap.

- Publica la home y una página “Acerca de” con datos de contacto claros.

- Crea enlaces internos desde la home hacia tus páginas clave.

- Añade tu negocio a Google Business Profile si aplica.

- Solicita indexación de las URLs prioritarias y registra todo en un doc de control.

Checklist en 7 días para sitios con historial

- Auditoría rápida:

robots.txt, metanoindex, cabeceras X‑Robots‑Tag, 5xx, 404, cadenas 301. - Limpieza del sitemap: solo 200 canónicas útiles.

- Fusión de thin content y arreglos de canibalización.

- Refuerzo del interlinking por clústeres.

- Mejora de UX y Core Web Vitals básicos (imágenes, fuentes, JS).

- Solicitud de re‑rastreo a páginas corregidas.

Métricas a vigilar en GSC y próximos pasos

Mira “Rendimiento” (impresiones, clics, CTR por consulta), “Páginas/Indexación” (exclusiones más frecuentes) y “Estadísticas de rastreo” (tiempo de respuesta y solicitudes diarias). Si tras 2–4 semanas no hay progreso en páginas clave, reevalúa intención y profundidad: ¿respondes mejor que los top‑3?, ¿atiendes las dudas reales del usuario?, ¿apoyas con enlaces internos y externos de calidad?

Árbol de decisión para diagnosticar por escenarios

Un mapa sencillo para pasar de la duda a la acción. Úsalo como guía de trabajo; en cada bifurcación te indico el movimiento exacto. Si es tu primer proyecto, sigue el camino de la izquierda. Si vienes de una migración o tienes historial, toma el de la derecha.

¿Tu sitio es nuevo (< 30 días)?

├─ Sí → Verifica propiedad en GSC → Envía sitemap → Crea enlaces internos desde la home y categorías → Solicita indexación

│ ¿Alguna URL indexada en 7–14 días?

│ ├─ Sí → Pasa a posicionamiento: intención de búsqueda + calidad + interlinking

│ └─ No → Revisa robots.txt, meta noindex y X‑Robots‑Tag; corrige 5xx/velocidad; refuerza interlinking; solicita rastreo de nuevo

└─ No → ¿site:dominio devuelve 0 resultados?

├─ Sí → Diagnóstico técnico: robots.txt, noindex en HTML/cabeceras, sitemap limpio, logs/errores de servidor

│ Si corriges → Envía sitemap + enlazado interno + solicitar indexación

└─ No → ¿Indexado pero no rankea?

├─ Sí → Audita intención, canibalización y thin content; mejora E‑E‑A‑T y Core Web Vitals

└─ No → Caso mixto “Descubierta pero no indexada” → Potencia enlaces internos, elimina duplicados, mejora calidad; espera 7–14 días y reevalúaConsejo para negocios locales

En paralelo, reclama y optimiza tu Google Business Profile con NAP coherente y primeras reseñas genuinas. Acelera el descubrimiento de marca y te da visibilidad en mapas.

Implementación rápida por CMS

WordPress en producción

La causa número uno de webs invisibles en WordPress es tener activo el ajuste de privacidad o un noindex involuntario. A eso se suman sitemaps duplicados por plugins, robots demasiado agresivos y enlaces internos escasos. Mi secuencia exprés para dejarlo fino en un día es esta:

- Privacidad: ve a Ajustes → Lectura y asegúrate de que NO está marcada “Disuade a los motores de búsqueda de indexar este sitio”.

- Meta robots: abre el código fuente de la home y busca

meta name="robots". No debería decirnoindex. Si no aparece, WordPress indexa por defecto. - Sitemap único: usa un solo plugin SEO (Rank Math o Yoast). Activa su sitemap y desactiva el del otro si lo tuvieras. Comprueba

tudominio.com/sitemap.xml. - robots.txt seguro: permite recursos críticos y declara el sitemap. Evita bloqueos genéricos tipo

/wp-.

User-agent: *

Allow: /

Sitemap: https://tudominio.com/sitemap.xml- Interlinking: enlaza desde la home y el menú a tus páginas objetivo. Añade migas de pan y módulos de “relacionados”.

- GSC: verifica propiedad (DNS o etiqueta HTML), envía el sitemap, inspecciona 3–5 URLs clave y solicita indexación.

- Rendimiento: comprime imágenes, limita scripts del tema/constructor y elimina redirecciones en cadena. Un TTFB bajo mejora el rastreo.

Shopify en producción

Shopify suele indexar rápido, pero hay tres bloqueos típicos: tienda protegida con contraseña, plantillas con noindex y proliferación de URLs facetadas (filtros/sort) que diluyen el rastreo. Esta es la ruta directa:

- Contraseña: en Online Store → Preferences desactiva la protección por contraseña cuando pases a producción. Con la protección activa Google no puede indexar tu catálogo.

- Sitemap: Shopify lo genera en

tudominio.com/sitemap.xml. Envíalo en GSC y comprueba “Descubiertas” vs “Indexadas”. - Meta robots y canónicas: revisa

theme.liquidy plantillas de producto/colección. No debe habernoindexsalvo casos puntuales; mantén la etiquetalink rel="canonical"por defecto hacia la URL limpia. - robots.txt.liquid: si necesitas controlar parámetros ruidosos, crea/edita este archivo. Evita bloquear recursos esenciales y limita solo parámetros problemáticos:

User-agent: *

Disallow: /*?sort_by=

Disallow: /*&sort_by=

Sitemap: https://tudominio.com/sitemap.xml- Interlinking y colecciones: enlaza productos destacados desde la home y colecciones principales. Evita indexar paginaciones/filtros como páginas “finales” (usa canónica a la colección raíz).

- Rendimiento: elimina apps innecesarias y scripts de seguimiento duplicados; cada app añade latencia y DOM.

Tip

Tras cualquier corrección, inspecciona 3–10 URLs representativas en GSC, solicita indexación y monitoriza durante 7–14 días. Si no hay mejoras, regresa al árbol de decisión y revisa calidad, canibalización y enlazado.

Preguntas frecuentes que te ahorran tiempo

¿Cuánto tarda Google en indexar una página nueva?

De horas a semanas. Aceleras con GSC y enlaces internos; no está garantizado.

¿Puedo impedir la indexación con robots.txt?

No. Robots controla el rastreo; para desindexar usa noindex o elimina/redirige la URL.

¿Qué hago con “Descubierta pero no indexada”?

Mejora calidad y enlazado interno, evita duplicados, solicita indexación y revisa el sitemap.

¿Necesito sí o sí un sitemap?

No es obligatorio, pero es muy recomendable: facilita el descubrimiento y el control.

¿Por qué aparece mi home como “Inicio” en Google?

Porque tu título es genérico. Edita el snippet (título y descripción) y alinea con tu propuesta de valor

Si quieres conocer otros artículos parecidos a ¿Por qué mi web no aparece en google? puedes visitar la categoría SEO.

Deja una respuesta

Entradas Relacionadas